Era sábado a las 12 del mediodía. Estaba en mi auto, en el estacionamiento de la iglesia a la que asisto, todavía procesando el sermón, cuando me llegó un mensaje de una paciente (los detalles han sido modificados para proteger su confidencialidad): estaba pasando un mal momento, necesitaba practicar sus habilidades DBT y no encontraba su manual. Estaba desesperada.

Saqué el celular, abrí Claude, mi app de IA favorita, y le pedí que preparara un handout para el coaching telefónico que iba a tener con ella (en DBT, los pacientes pueden llamar al terapeuta entre sesiones para practicar habilidades en momentos de crisis). Claude me hizo algunas preguntas para entender mejor el contexto y las necesidades de la paciente, respondí desde el celular, y en unos minutos tenía el recurso listo.

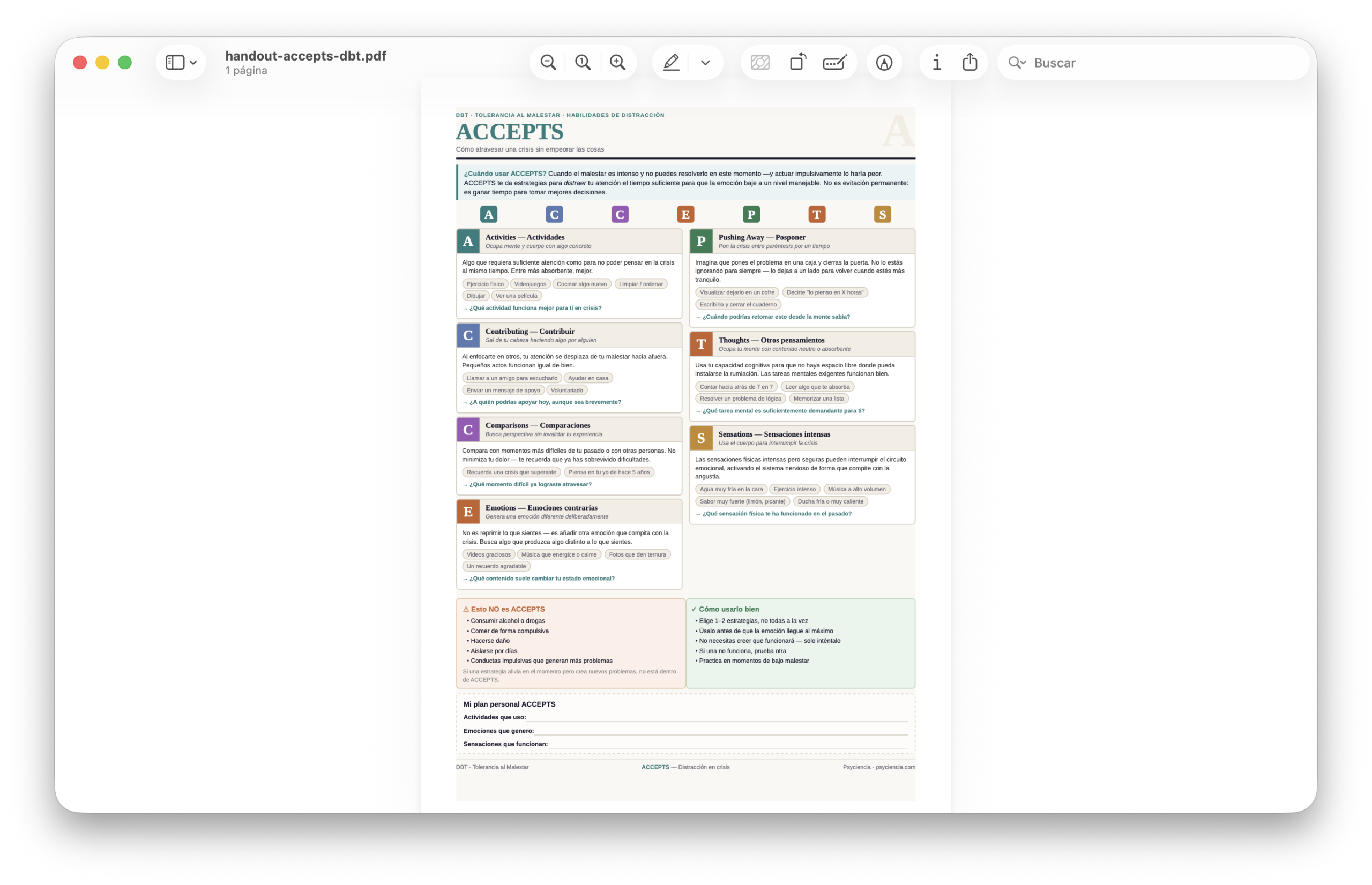

Tengo años trabajando con esta paciente y, según lo que me estaba contando, sabía que necesitaba practicar ACCEPTS, una habilidad de tolerancia al malestar que ella ya conocía del grupo. Esa decisión fue mía, no de Claude. Fue una decisión clínica, hecha por un humano que conoce bien el modelo y que conoce bien a su paciente1. La IA no evaluó nada, no decidió nada. Entendió lo que le pedí y lo ejecutó rápido y bien.

No le estoy diciendo a todo el mundo que use IA para preparar materiales clínicos. Pero un clínico que conoce su modelo y conoce a su paciente puede usarla para moverse más rápido sin sacrificar calidad ni ética profesional.

Los grandes modelos de lenguaje, como Claude o ChatGPT, pueden generar recursos muy útiles en manos de un terapeuta con experiencia y formación clínica. Ahí está el verdadero beneficio de estas herramientas: no en automatizar la clínica, sino en reducir la fricción para que el terapeuta pueda enfocarse en lo que importa, en mi caso: prevenir una crisis.

Si no supiera usar Claude, hubiera tenido que buscar en mis archivos, encontrar el PDF correcto y enviárselo, todo eso mientras la paciente esperaba. En cambio, tuve esto en dos minutos:

Puedes descargar el recurso desde aquí.

¿Por qué Claude?: Uso Claude porque para la práctica clínica me resulta más útil. Es más sensible al contexto y hace preguntas para adaptar sus respuestas antes de responder de forma genérica, es más cuidadoso en cómo maneja temas sensibles, los resultados son más detallados y mejor presentados, y su capacidad de integración y automatización va mucho más allá de lo que he podido hacer con ChatGPT. No digo que ChatGPT sea malo, pero si eres psicólogo y quieres incorporar IA en tu práctica, Claude vale la pena explorar.

Creo que los psicólogos clínicos podemos beneficiarnos mucho de la inteligencia artificial siempre y cuando sepamos qué queremos hacer y cómo utilizarlos. Estos sistemas no nos suplantan, pero pueden hacer nuestro trabajo más eficiente y fácil, como lo fue hoy desde el estacionamiento de la iglesia.

Nota al pie de página:

- Hoy usamos expresiones como «texto generado por humano» para distinguir lo que escribimos nosotros de lo que produce una IA, algo que hace diez años hubiera sonado absurdo porque todo texto era por definición humano. En el ámbito clínico todavía no hemos llegado a ese punto, pero si los modelos de lenguaje siguen integrándose en la práctica, es probable que en algún momento tengamos que especificar «decisión clínica tomada por un humano», no porque sea lo inusual, sino precisamente para dejar claro que no lo es. Que loco es todo esto.