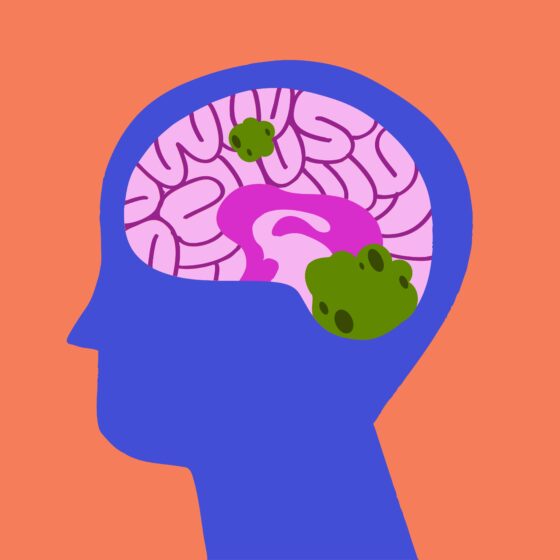

Prima: IA que diagnostica condiciones neurológicas a partir de resonancias magnéticas en segundos

Un modelo de inteligencia artificial desarrollado en la Universidad de Michigan puede leer una resonancia magnética cerebral y diagnosticar condiciones neurológicas con hasta 97.5% de precisión, según un estudio recién…